Ando alucinando com esses pensamentos

Dra. Juliana Gabriel Jornalzinho anti-fomo 0

No nosso último jornalzinho, começamos o diálogo sobre o impacto das IAs na nossa vida: o quanto que isso já está presente e, por outro lado, o quanto esse excesso de tecnologia tem sido um chamado para nos reconectarmos com a nossa humanidade.

(se você não leu, clica aqui para ler) https://comunidade-tribu.circle.so/c/conteudos/jornalzinho-anti-fomo-10-eec340ae-da85-4331-86f7-c7f90cfca62d

E no editorial deste mês, queria dar continuidade a essa conversa. Minha intenção é trazer uma reflexão sobre os dois lados das IAs, pois, assim como tudo na vida, a presença (cada vez maior) dela nas nossas vidas tem pontos positivos e negativos.

Por um lado, a tecnologia das IAs (quando bem utilizada) pode gerar ferramentas incríveis e com grande impacto positivo na saúde, como por exemplo o projeto Tia Bete*, que conheci recentemente num congresso.

A “Tia Bete” é uma ferramenta de IA que conversa pelo whatsapp com pessoas portadoras de Diabetes e auxilia em diversas questões, como por exemplo, a contagem de carboidratos de uma refeição, o cálculo de dose de insulina e até informações sobre a doença. Ela é gratuita para os usuários (recebe financiamento da indústria) e foi criada por um jovem médico que também é portador de diabetes tipo 1. Toda a informação fornecida por essa IA passou primeiro pelos médicos envolvidos no projeto, que se empenham em aumentar cada vez mais a base de dados e deixá-la cada vez mais acurada para os pacientes e usuários da ferramenta. Essa é uma ferramenta realmente muito bacana e vou escrever um post futuramente, só pra falar dela.

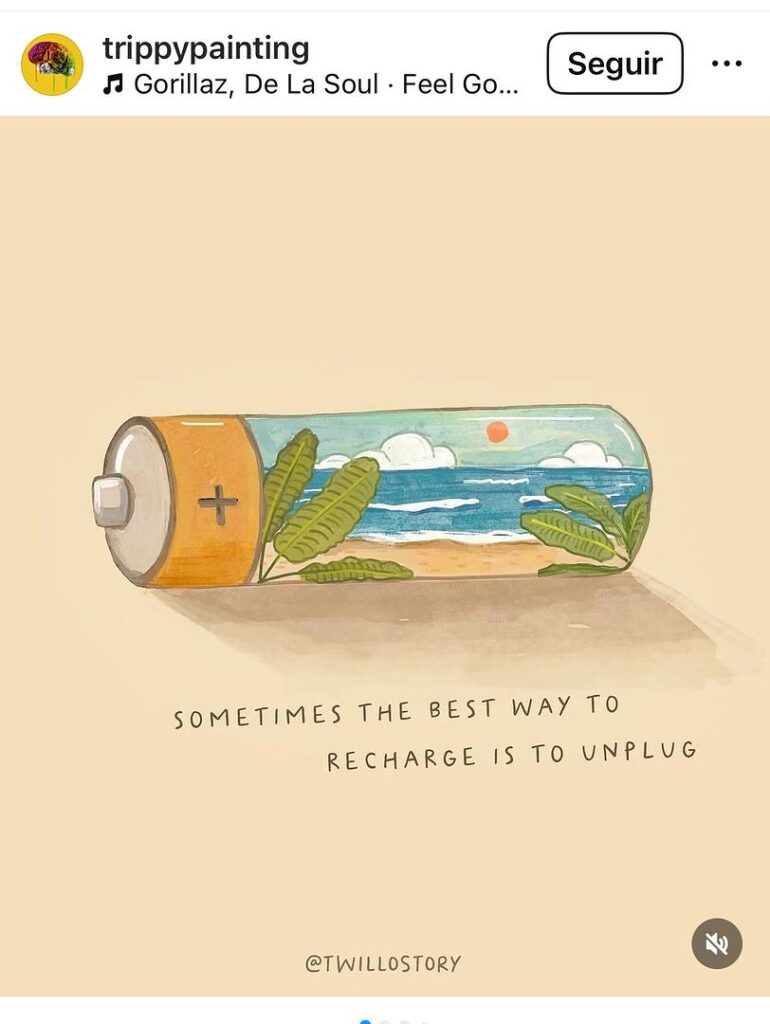

Porém, por outro lado, cada vez mais aparecem casos de resultados errados vindos dos GPTs (as chamadas “alucinações”), que muita gente não sabe que acontece.

Somos uma geração que se acostumou a pesquisar tudo no Google.

Mesmo sabendo que existem informações falsas na internet, quando fazemos uma pesquisa no Google, sabíamos de onde a informação estava vindo. Se a fonte era um site oficial (como o site do Ministério da Saúde por exemplo), tínhamos pelo menos algum grau de segurança que se tratava de uma informação verdadeira.

Mas, nas ferramentas de IA (como o chat GPT, a IA do whatsapp e, mais recentemente, a IA do próprio google), a fonte não está tão clara. E muitas vezes, a informação está errada, mas colocada de uma forma que parece certa.

E por que isso acontece?

Conversando sobre isso com um grande amigo, o Leonel (que é engenheiro, trabalha na área, tem um canal do Youtube que fala sobre esses temas e é o pai da minha linda afilhada Madalena), recebi uma explicação muito didática que queria compartilhar com vocês. Então, convidei ele para colaborar com um texto para o nosso jornalzinho, que você vai ver a seguir.

Mas a pergunta que fica é: como lidar com isso?

Como lidar? Pois é bem óbvio que o acesso às ferramentas de IA transformou a nossa rotina, facilitou diversos processos e aumentou a produtividade.

Mas qual o limite entre o uso adequado e o uso perigoso?

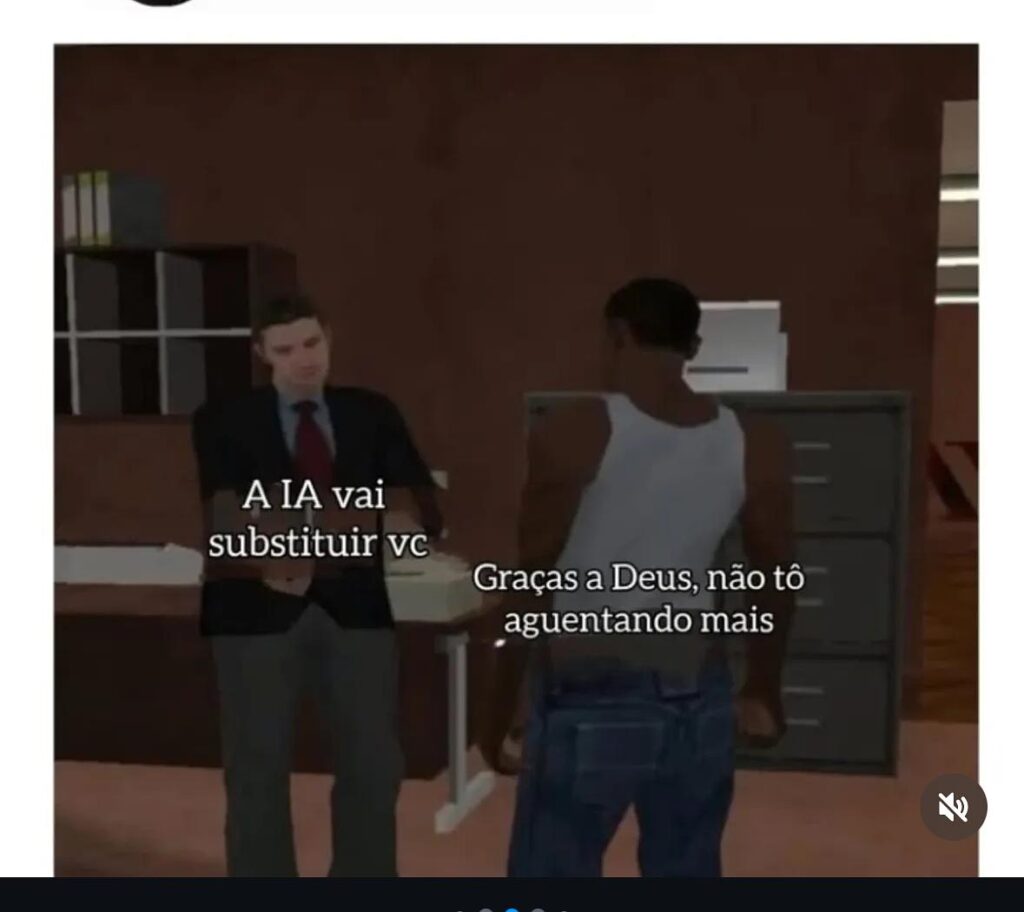

Até que ponto podemos permitir que as IAs substituam pessoas?

Queria muito conversar com vocês sobre isso e ouvir o que pensam.

Vamos continuar essa conversa aqui na comunidade? Clique aqui para se cadastrar!

Um grande abraço a todes, ainda com a cabeça meio assim: 🤯